[مترجم]: اگرچه هنوز کتابی که تحت عنوان کاربردهای نظامی هوش مصنوعی ترجمه کرده ام منتشر نشده است، و به زودی به دست مخاطبان خواهد رسید، اما این مقاله کوتاه، اشاره های جالب و قابل تاملی به کاربردهای نظامی هوش مصنوعی و نگرانی های مربوط به آن نموده است. اسرائیل، به واقع در مضحک ترین و کاریکاتور گونه ترین رفتارها را به انجام می رساند. من به این مقاله یک موضوع مهم اشاره می کنم. فنآوری مبتنی بر جغرافیا است. به شدت به ملت و جغرافیایی که آن را تولید می کند وابسته است. و هوش مصنوعی از این قاعده مستثنی نیست. در ادامه بخوانید و از چهره هوش مصنوعی برخواسته از جغرافیا و ملت اشغالگر اسرائیل رمزگشایی نمایید.

انجیل[1]: چگونه اسرائیل از هوش مصنوعی برای انتخاب اهداف بمباران در غزه استفاده می کند؟

نگرانی در مورد «کارخانه» مبتنی بر داده ها که به طور قابل توجهی تعداد اهداف برای حملات در خاک فلسطین را افزایش می دهد.

ارتش اسرائیل شدت بمباران نوار غزه را پنهان نکرده است. در روزهای اولیه تهاجم، رئیس نیروی هوایی ارتش از حملات هوایی بی امان «بیست و چهار ساعته» صحبت کرد. او گفت که نیروهایش فقط به اهداف نظامی حمله می کردند، اما او اضافه کرد: «ما جراحی نمی کنیم.»

با این حال، توجه نسبتاً کمی به روشهای استفاده شده توسط نیروهای دفاعی اسرائیل (IDF) برای انتخاب اهداف در غزه و نقش هوش مصنوعی در بمباران آنها شده است. در حالی که اسرائیل حملات خود را پس از یک آتش بس هفت روزه از سر گرفته است، نگرانیهای فزایندهای در مورد رویکرد هدفگیری ارتش اسرائیل در جنگ علیه حماس وجود دارد که به گفته وزارت بهداشت در غزه که حماس اداره میکند، تاکنون بیش از 15000 نفر در این منطقه کشته شدهاند.

ارتش اسرائیل مدتهاست که شهرت خود را به دلیل مهارت فنی حفظ کرده است و قبلاً ادعاهای جسورانه اما غیرقابل تأیید در مورد استفاده از فناوری جدید داشته است. پس از جنگ 11 روزه غزه در ماه مه 2021، مقامات گفتند که اسرائیل «اولین جنگ هوش مصنوعی» خود را با استفاده از یادگیری ماشینی و محاسبات پیشرفته انجام داده است.

آخرین جنگ اسرائیل و حماس فرصت بیسابقهای را برای ارتش اسرائیل فراهم کرده است تا از چنین ابزارهایی در صحنه عملیاتی بسیار گستردهتر و بهویژه برای استقرار یک پلتفرم ایجاد هدف هوش مصنوعی به نام «انجیل» استفاده کند، که به طور قابل توجهی خط تولید کشنده اهدافی را که مقامات با یک «کارخانه» مقایسه کرده اند، سرعت بخشیده است.

گاردین می تواند با استفاده از مصاحبه با منابع اطلاعاتی و اظهارات کم توجه ارتش اسرائیل و مقامات بازنشسته، جزئیات جدیدی درباره «انجیل» و نقش مرکزی آن در جنگ اسرائیل در غزه فاش کند.

این مقاله همچنین بر اساس گواهیهای منتشر شده توسط نشریه اسرائیلی-فلسطینی (+972 Magazine) و رسانه عبری زبان (Local Call) است که با چندین منبع فعلی و سابق در جامعه اطلاعاتی اسرائیل که از پلت فرم «انجیل» اطلاع دارند، مصاحبه کرده است.

نظرات آنها نگاهی اجمالی به داخل یک واحد اطلاعات نظامی مخفی و با تسهیلات هوش مصنوعی دارد که نقش مهمی در واکنش اسرائیل به قتل عام حماس در جنوب اسرائیل در 7 اکتبر ایفا می کند.

تصویری که به آرامی در حال ظهور است از نحوه استفاده ارتش اسرائیل از هوش مصنوعی در برابر پس زمینه نگرانی های فزاینده در مورد خطرات ناشی از غیرنظامیان به وجود می آید زیرا ارتش های پیشرفته در سراسر جهان استفاده از سیستم های خودکار پیچیده و غیر شفاف را در میدان جنگ گسترش می دهند.

یک مقام امنیتی سابق کاخ سفید که با استفاده ارتش آمریکا از سیستمهای خودمختار آشناست، گفت: «دولتهای دیگر به تماشا و یادگیری خواهند پرداخت.»

آنها گفتند که جنگ اسرائیل و حماس «لحظه مهمی خواهد بود اگر ارتش اسرائیل از هوش مصنوعی به طور قابل توجهی برای انتخاب هدف گیری با پیامدهای مرگ و زندگی استفاده کند».

از 50 هدف در سال تا 100 هدف در روز

در اوایل نوامبر، ارتش اسرائیل اعلام کرد که «بیش از 12000» هدف در غزه توسط بخش مدیریت هدف آن شناسایی شده است.

یک مقام مسئول در تشریح روند هدفگیری این یگان گفت: «ما بدون سازش در تعیین اینکه دشمن کیست و چیست کار میکنیم. عوامل حماس در امان نیستند -مهم نیست کجا پنهان شوند.»

فعالیتهای این بخش که در سال 2019 در اداره اطلاعات ارتش اسرائیل تشکیل شد، طبقهبندی شده است.

با این حال، بیانیه کوتاهی در وبسایت ارتش اسرائیل مدعی شد که از یک سیستم مبتنی بر هوش مصنوعی به نام (Habsora) ((Gospel) به زبان انگلیسی [و انجیل (مسیح) در فارسی) در جنگ علیه حماس برای «ارائه اهداف با سرعت سریع» استفاده میکند.

ارتش اسرائیل گفت که «از طریق استخراج سریع و خودکار اطلاعات»، انجیل توصیههای هدفگیری را برای محققان خود «با هدف تطبیق کامل بین توصیههای دستگاه و شناسایی انجامشده توسط یک فرد» ارائه کرد.

چندین منبع آشنا با فرآیندهای هدفگیری ارتش اسرائیل وجود انجیل به (+972/Local Call) را تأیید کردند و گفتند که از آن برای تهیه توصیههای خودکار برای حمله به اهدافی مانند خانههای شخصی افراد مظنون به عضویت حماس یا جهاد اسلامی استفاده شده است.

در سال های اخیر، لشکر هدف به ارتش اسرائیل کمک کرده است تا پایگاه داده ای از آنچه که منابع گفته اند بین 30000 تا 40000 شبه نظامی مظنون را تشکیل دهد، بسازد. به گفته آنها، سیستم هایی مانند انجیل، نقش مهمی در تهیه لیست افراد مجاز برای ترور داشتند.

آویو کوچاوی که تا ژانویه به عنوان رئیس ارتش اسرائیل خدمت کرد، گفته است که لشکر هدف «با قابلیت های هوش مصنوعی» و شامل صدها افسر و سرباز است.

او در مصاحبهای که قبل از جنگ منتشر شد، گفت: «ماشینی است که حجم وسیعی از دادهها را مؤثرتر از هر انسان دیگری تولید میکند و آنها را به اهدافی برای حمله تبدیل میکند».

به گفته کوچاوی، زمانی که این ماشین در جنگ 11 روزه اسرائیل با حماس در ماه مه 2021 فعال شد، روزانه 100 هدف تولید می کرد. برای در نظر گرفتن این موضوع، در گذشته ما سالانه 50 هدف در غزه تولید می کردیم. اکنون این دستگاه روزانه 100 هدف تولید می کند که 50 درصد آنها مورد حمله قرار می گیرند.

دقیقاً مشخص نیست که چه اشکالی از داده ها در انجیل گنجانده شده است. اما کارشناسان میگویند سیستمهای پشتیبانی تصمیم مبتنی بر هوش مصنوعی برای هدفگیری معمولاً مجموعههای بزرگی از اطلاعات را از طیف وسیعی از منابع، مانند فیلمهای پهپاد، ارتباطات رهگیری شده، دادههای نظارتی و اطلاعات به دست آمده از نظارت بر حرکات و الگوهای رفتاری افراد و گروههای بزرگ تجزیه و تحلیل میکنند.

لشکر هدف برای رسیدگی به یک مشکل مزمن برای ارتش اسرائیل ایجاد شد: در عملیات های قبلی در غزه، نیروی هوایی مکرراً اهدافی را برای حمله سوزاند. منابع گفتند، از آنجایی که مقامات ارشد حماس در آغاز هر حمله جدید در تونل ها ناپدید شدند، سیستم هایی مانند انجیل به ارتش اسرائیل اجازه دادند تا مجموعه بزرگتری از عملیات های کوچکتر را پیدا کرده و به آنها حمله کنند.

یکی از مقامات که در عملیات های قبلی غزه روی هدف گیری تصمیمات کار می کرد، گفت که ارتش اسرائیل قبلا خانه های اعضای کوچک حماس را برای بمباران هدف قرار نداده بود. آنها گفتند که بر این باورند که برای درگیری کنونی تغییر کرده است و خانه های مظنونان عملیات حماس بدون در نظر گرفتن رتبه هدف قرار گرفته است.

این مقام به (+972/Local Call) گفت: «اینجا خانههای زیادی است. اعضای حماس که واقعاً هیچ اهمیتی ندارند در خانههای غزه زندگی میکنند. بنابراین خانه را علامت گذاری می کنند و خانه را بمباران می کنند و همه را در آنجا می کشند.»

هدفها برای تلفات غیرنظامی احتمالی «امتیاز» می گیرند

در بیانیه کوتاه ارتش اسرائیل درباره لشکر هدف خود، یک مقام ارشد گفت که این یگان «حملات دقیقی را به زیرساختهای مرتبط با حماس انجام میدهد در حالی که خسارت زیادی به دشمن وارد میکند و کمترین آسیب را به غیرنظامیان وارد میکند».

دقت حملات توصیه شده توسط «بانک هدف هوش مصنوعی» در گزارش های متعدد رسانه های اسرائیلی مورد تاکید قرار گرفته است. روزنامه یدیعوت آحارونوت گزارش داد که این واحد «تا آنجا که ممکن است مطمئن می شود که آسیبی به غیرنظامیان غیر درگیر وارد نمی شود».

یک منبع ارشد سابق ارتش اسرائیل به گاردین گفت که نیروهای عملیاتی از یک اندازه گیری «بسیار دقیق» از میزان تخلیه غیرنظامیان یک ساختمان کمی قبل از حمله استفاده می کنند. ما از الگوریتمی برای ارزیابی تعداد غیرنظامیان باقی مانده استفاده می کنیم. به ما یک رنگ سبز، زرد، قرمز، مانند یک علامت راهنمایی و رانندگی می دهد.

با این حال، کارشناسان هوش مصنوعی و درگیریهای مسلحانه که با گاردین صحبت کردند، گفتند که نسبت به این ادعا که سیستمهای مبتنی بر هوش مصنوعی با تشویق هدفگیری دقیقتر، آسیب غیرنظامی را کاهش میدهند، تردید دارند.

وکیلی که به دولت ها در مورد هوش مصنوعی و رعایت قوانین بشردوستانه مشاوره می دهد، گفت که «شواهد تجربی کمی» برای حمایت از چنین ادعاهایی وجود دارد. برخی دیگر به تأثیر قابل مشاهده بمباران اشاره کردند.

ریچارد مویز، محققی که سرپرستی ماده 36 را بر عهده دارد، گفت: «به چشم انداز فیزیکی غزه نگاه کنید.»

«ما شاهد تسطیح گسترده یک منطقه شهری با تسلیحات انفجاری سنگین هستیم، بنابراین ادعای اینکه دقت و محدودیت نیرویی اعمال میشود، با واقعیت قابل اثبات نیست.»

تصویر 1: تصاویر ماهواره ای از شهر شمالی بیت حانون در غزه قبل از (10 اکتبر) و پس از (21 اکتبر) آسیب های ناشی از جنگ. عکس از رویترز

بر اساس آمار منتشر شده توسط ارتش اسرائیل در ماه نوامبر، اسرائیل در طول 35 روز اول جنگ به 15000 هدف در غزه حمله کرد، رقمی که به طور قابل توجهی بیشتر از عملیات نظامی قبلی در مناطق پرجمعیت ساحلی است. در مقایسه، در جنگ سال 2014 که 51 روز به طول انجامید، ارتش اسرائیل بین 5000 تا 6000 هدف را هدف قرار داد.

چندین منبع به گاردین و (+972/Local Call) گفتند که وقتی اجازه حمله به خانههای شخصی افراد فعال حماس یا جهاد اسلامی صادر شد، محققان هدف از قبل از تعداد غیرنظامیانی که انتظار میرفت کشته شوند، اطلاع داشتند.

آنها گفتند که هر هدف دارای پرونده ای بود که حاوی امتیاز خسارت جانبی بود که تعداد غیرنظامیان احتمال کشته شدن در یک حمله را مشخص می کرد.

یکی از منابعی که تا سال 2021 روی برنامه ریزی حملات برای ارتش اسرائیل کار می کرد، گفت: «تصمیم برای حمله توسط فرمانده یگان کشیک گرفته می شود» که برخی از آنها «خوشحال تر از دیگران بودند».

این منبع گفت که مواردی وجود داشته است که «در مورد یک هدف تردید وجود داشت» و «ما آنچه را که فکر می کردم تعداد نامتناسبی از غیرنظامیان بود را کشتیم».

سخنگوی ارتش اسرائیل گفت: «در پاسخ به حملات وحشیانه حماس، ارتش اسرائیل برای از بین بردن قابلیتهای نظامی و اداری حماس عمل میکند. برخلاف حملات عمدی حماس به مردان، زنان و کودکان اسرائیلی، ارتش اسرائیل از قوانین بینالمللی پیروی میکند و اقدامات احتیاطی ممکن را برای کاهش آسیب غیرنظامیان انجام میدهد.»

کارخانه کشتار دسته جمعی

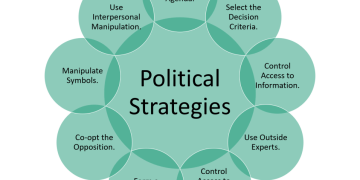

منابع آشنا با نحوه ادغام سیستم های مبتنی بر هوش مصنوعی در عملیات ارتش اسرائیل گفتند که چنین ابزارهایی به طور قابل توجهی روند ایجاد هدف را سرعت بخشیده اند.

منبعی که قبلاً در بخش هدف کار می کرد به (+972/Local Call) گفت: «ما اهداف را به طور خودکار آماده می کنیم و طبق یک چک لیست کار می کنیم. این واقعاً مانند یک کارخانه است. ما به سرعت کار می کنیم و زمانی برای کاوش عمیق در هدف وجود ندارد. دیدگاه این است که ما بر اساس تعداد اهدافی که میتوانیم ایجاد کنیم قضاوت میکنیم.»

یک منبع جداگانه به این نشریه گفت که انجیل به ارتش اسرائیل اجازه داده است تا یک «کارخانه ترور دسته جمعی» را اداره کند که در آن «تاکید بر کمیت است و نه کیفیت». آنها گفتند: «یک چشم انسانی قبل از هر حمله به هدفها نگاه خواهد کرد، اما نیازی نیست که زمان زیادی را صرف آنها کند».

برای برخی از کارشناسانی که در زمینه هوش مصنوعی و حقوق بشردوستانه بینالمللی تحقیق میکنند، شتابی از این نوع نگرانیهایی را ایجاد میکند.

دکتر مارتا بو، محقق مؤسسه تحقیقات صلح بینالمللی استکهلم، گفت که حتی زمانی که «انسان ها در جریان هستند» این خطر وجود دارد که آنها «سوگیری اتوماسیون» و «تکیه بیش از حد به سیستم هایی دارند که بر تصمیمات پیچیده انسانی تاثیر زیادی دارند».

مویس، از ماده 36، گفت که هنگام تکیه بر ابزارهایی مانند انجیل، به یک فرمانده «لیستی از اهدافی که یک کامپیوتر تولید کرده است داده می شود» و آنها «لزوما نمی دانند که لیست چگونه ایجاد شده است یا توانایی تحقیق کافی و زیر سوال بردن توصیه های هدف گیری را ندارند».

وی افزود: «این خطر وجود دارد که وقتی انسانها به این سیستمها تکیه میکنند، در یک فرآیند مکانیزه تبدیل به چرخدنده میشوند و توانایی در نظر گرفتن خطر آسیب غیرنظامی را به روشی معنیدار از دست میدهند.»

————-

[1] – (gospel): کلمه (gospel) از خدای انگلیسی باستان (good) به معنای «خوب» و (spel) به معنای «خبر، یک داستان» گرفته شده است. در مسیحیت، اصطلاح «بشارت» [یا مژده] به داستان تولد، مرگ و رستاخیز عیسی مسیح اشاره دارد.