مقدمه

هوش مصنوعی (AI) به عنوان یکی از تحولآفرینترین فناوریهای قرن بیست و یکم، از زمان عرضه عمومی ابزارهایی مانند ChatGPT در نوامبر ۲۰۲۲، توجه گستردهای را به خود جلب کرده است. پیشرفتهای شتابان این فناوری، که اغلب با سرمایهگذاریهای کلان شرکتهای بزرگ فناوری همراه بوده، نه تنها امید به بهبود کارایی و نوآوری را برانگیخته، بلکه نگرانیهای عمیقی در مورد پیامدهای اجتماعی، اقتصادی و اخلاقی آن ایجاد کرده است.

بر اساس نظرسنجی جهانی مرکز تحقیقات پیو (Pew Research Center) که در بهار ۲۰۲۵ در ۲۵ کشور انجام شده، نگرش عمومی نسبت به هوش مصنوعی در حال گذار از هیجان اولیه به تردید و نگرانی غالب است. این نظرسنجی نشان میدهد که میانگین ۳۴ درصد از بزرگسالان در این کشورها آگاهی بالایی از AI دارند، در حالی که احساس غالب، نگرانی بیشتر از هیجان است. این یافتهها، که بر پایه دادههای معتبر و نماینده از جوامع متنوع جمعآوری شده، حکایت از شکافهای عمیق در آگاهی، دسترسی و توزیع منافع این فناوری دارد. در این مقاله، با تکیه بر شواهد این گزارش، ابعاد مختلف این پدیده را بررسی میکنیم تا درک بهتری از چالشهای پیش روی جامعه جهانی در مواجهه با هوش مصنوعی به دست آید.

نابرابری در آگاهی و دسترسی (گسل دیجیتال)

یکی از برجستهترین یافتههای نظرسنجی پیو، وجود نابرابری چشمگیر در سطح آگاهی از هوش مصنوعی است. میانگین جهانی نشان میدهد که تنها ۳۴ درصد از بزرگسالان آگاهی بالایی («زیاد») دارند، در مقابل ۴۷ درصد که آشنایی کمی گزارش کردهاند و ۱۴ درصد که هیچ شناختی ندارند. این توزیع نابرابر، مستقیماً با عوامل اقتصادی-اجتماعی مرتبط است.

از منظر جهانی، رابطهای مثبت و قوی بین سطح توسعه اقتصادی کشورها و آگاهی عمومی مشاهده میشود. برای نمونه، در ایالات متحده با تولید ناخالص داخلی سرانه حدود ۸۶,۰۰۰ دلار، ۴۷ درصد افراد آگاهی بالا دارند، در حالی که در کنیا با تولید ناخالص داخلی سرانه حدود ۲,۲۰۰ دلار، این رقم تنها ۱۲ درصد است. این شکاف، ریشه در دسترسی نابرابر به اینترنت، آموزش و زیرساختهای دیجیتال دارد؛ افرادی که اینترنت را تقریباً مداوم استفاده میکنند، به طور قابل توجهی آگاهی بیشتری نشان میدهند.

در سطح داخلی جوامع نیز، این نابرابری تکرار میشود: افراد ثروتمندتر، جوانتر (به ویژه زیر ۳۵ سال)، دارای تحصیلات بالاتر و کاربران پرتعداد اینترنت، آشنایی بیشتری با AI دارند. این الگو، که در اکثر کشورهای مورد بررسی تکرار شده، نشاندهنده تشدید گسل دیجیتال است. استدلال عقلی اینجا این است که هوش مصنوعی، به عنوان فناوریای که بر داده و اتصال وابسته است، естественно در جوامع مرفهتر و متصلتر نفوذ بیشتری مییابد و این امر میتواند به چرخهای معیوب منجر شود که نابرابریهای موجود را عمیقتر کند.

نگرانی غالب بر هیجان و گروههای آسیبپذیر

احساس عمومی نسبت به گسترش هوش مصنوعی در زندگی روزمره، بیشتر به سمت نگرانی گرایش دارد. میانگین ۳۴ درصد از پاسخدهندگان اعلام کردهاند که بیشتر نگران هستند تا هیجانزده، در حالی که این نگرانی در گروههای خاصی نامتناسب بالاتر است: سالمندان، زنان، افراد با تحصیلات پایینتر و کاربران کماینترنت.

ترس اصلی، جانشینی مشاغل انسانی توسط ماشینها است، که ریشه در تجربیات تاریخی اتوماسیون دارد. این نگرانی، منطقی به نظر میرسد زیرا پیشرفت AI در حوزههایی مانند پردازش داده و وظایف تکراری، مستقیماً بر مشاغل کممهارت تأثیر میگذارد. از سوی دیگر، هیجان بیشتر در میان جوانان و کاربران سنگین اینترنت دیده میشود، که احتمالاً به دلیل مواجهه مستقیم با مزایای کاربردی AI است.

تناقض اقتصادی: ثروت متمرکز در برابر ناامنی عمومی

از زمان عرضه ChatGPT، ارزش بازار هفت غول فناوری (معروف به «هفت شگفتانگیز»: اپل، مایکروسافت، آلفابت، آمازون، انویدیا، متا و تسلا) رشد چشمگیری حدود ۱۷۰ درصد داشته است. این رشد، ناشی از سرمایهگذاریهای کلان در زیرساختهای AI، موتور محرک اقتصاد دیجیتال تلقی میشود.

با این حال، دادههای نظرسنجی نشان میدهد که این ثروتآفرینی به بهبود رفاه عمومی منجر نشده است. مزایای ملموس AI عمدتاً در انحصار نخبگان فناوری و سرمایهداران باقی مانده، در حالی که برای اکثریت، به شکل تهدید شغلی ظاهر شده است. این تناقض، از منظر عدالت توزیع، قابل انتقاد است: رشد اقتصادی که منافع آن عادلانه توزیع نشود، نه تنها نگرانیها را کاهش نمیدهد، بلکه به بحران اعتماد دامن میزند.

ماهیت مبهم و ریسکهای امنیتی-اخلاقی

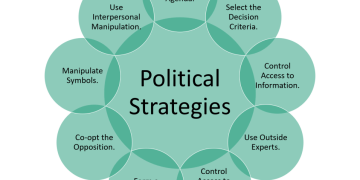

بخشی از تردید عمومی، ریشه در غیرشفاف بودن سیستمهای AI دارد. حتی طراحان این سیستمها، به دلیل مکانیسم خودآموزی (Self-Learning)، نمیتوانند خروجی نهایی را کامل پیشبینی کنند. این ناشناختگی، پرسشهای جدی مطرح میکند: امکان دستکاری سیستمها توسط بازیگران مخرب (دولتهای متخاصم، تروریستها یا مجرمان سایبری)، سوءاستفاده احتمالی، و مسئولیتپذیری در برابر اشتباهات AI.

این ریسکها، که اغلب به «بمب اتم سیلیکونی» تشبیه میشوند، استدلالی عقلی برای نیاز به شفافیت بیشتر ارائه میدهند. عدم کنترل کامل بر AI پیشرفته، میتواند به پیامدهای غیرقابل بازگشت منجر شود.

نتیجهگیری

یافتههای نظرسنجی پیو حکایت از شکلگیری یک بحران اعتماد جهانی نسبت به هوش مصنوعی دارد. مردم از مصرفکنندگان هیجانزده اولیه به ذینفعان نگران و محتاط تبدیل شدهاند. این گذار، ناشی از نابرابری آگاهی، تمرکز منافع اقتصادی، نگرانیهای شغلی و ریسکهای اخلاقی-امنیتی است. در حالی که AI پتانسیل تحول مثبت دارد، توزیع نابرابر مزایا و عدم شفافیت، آن را به تهدیدی برای انسجام اجتماعی تبدیل کرده است. جمعبندی کلی این است که آینده AI نه تنها به پیشرفت فنی، بلکه به توزیع عادلانه منافع و حکمرانی مسئولانه وابسته است.